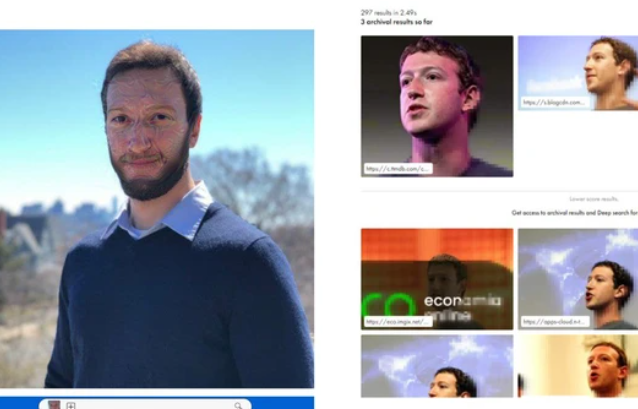

Investigadores da Escola de Ciência Informática de Blavatnik e da Escola de Engenharia Elétrica de Telavive demonstraram um método que cria ‘faces-mestras’ desenhadas para enganar sistemas de reconhecimento facial. Segundo esta equipa, as imagens dos rostos artificiais conseguem replicar quase metade das faces carregadas nas bases de dados de três destes sistemas que lideram o segmento. Sem mais qualquer informação ou dado, este conjunto de caras foi capaz de se fazer passar por mais de 40% da população destas bases.

Todas as ‘faces-mestras’ criadas apresentam a tendência de não ter pelos faciais, não usar óculos e de ser de pessoas mais velhas. A inspiração para este trabalho surge de um outro estudo anterior, que visou a criação de impressões digitais mestras, noticia o Vice.

Os cientistas submeteram as faces criadas aos sistemas da Dlib, FaceNet e SphereFace, soluções que são alegadamente capazes de reconhecer outros critérios que não apenas a cor da pele ou os efeitos de iluminação. As imagens foram criadas com uma rede adversarial StyleGAN e foi aplicado um algoritmo evolucionário e redes neurais que afinaram os resultados. O algoritmo ajudou a treinar a rede, desenvolver diferentes iterações ou gerações de imagens que foram apresentando progressivamente maiores probabilidades de sucesso em conseguir iludir os sistemas.

Ron Shmelkin, que liderou os trabalhos, afirma que “estamos interessados em continuar a explorar a possibilidade de usar as faces-mestras geradas pelo nosso método para ajudar a proteger os sistemas de reconhecimento facial deste tipo de ataques”.

O estudo envolveu a criação de nove rostos, sete homens e duas mulheres, ajustando a estratégia aos grupos com menor variação (o dos homens brancos com mais de 60 anos) ou aos de menor representatividade (apenas 22% dos rostos conjunto de dados da Labeled Faces in the Wild são de mulheres).

Este trabalho demonstra que os sistemas de reconhecimento facial, apesar de avançados, ainda têm várias fragilidades e podem ser iludidos com relativa facilidade.