É um facto inquestionável que a inteligência artificial (IA) se está a tornar numa parte cada vez mais intrínseca das nossas vidas e, pese embora o facto de tudo o que este conceito promete ter algo de apaixonante, o seu valor não passou despercebido aos criminosos da nossa sociedade.

Um dos maiores benefícios da IA é a sua capacidade de atuar como um amplificador que ajuda as pessoas a trabalhar com uma grande quantidade de dados complexos e realizar tarefas altamente repetitivas que, normalmente, requereriam a intervenção de um humano. A automatização do que normalmente seria um processo manual permite aos delinquentes, especialmente aos cibercriminosos, melhorar a seleção de alvos, ampliar a escala dos ataques e aumentar a velocidade a que podem criar novo malware. Embora até agora se tenham visto poucos exemplos de ataques que recorrem a IA, os investigadores de segurança estão a trabalhar muito para explorar o que é possível ou não fazer.

Seguem-se alguns exemplos sobre como os atacantes podem utilizar a IA:

▪ Eludir os sistemas CAPTCHA. O CAPTCHA tornou-se numa ferramenta essencial na Internet que permite determinar se a pessoa que visita o nosso site é um humano ou um bot. Os visitantes deparam-se com uma imagem, uma casa de verificação ou uma cadeia de texto distorcido e é-lhes pedido que realizem uma ação que normalmente requereria a intervenção de um ser humano, como a identificação de imagens similares entre si. Através do uso de técnicas de IA, investigadores da Universidade de Columbia conseguiram furar o CAPTCHA do Google 98% das vezes [VER AQUI].

▪ Melhorar a precisão e o alcance do phishing. 76% das organizações foram vítimas de ataques de phishing em 2017 e, em resposta, muitas implementaram rigorosos programas para os seus colaboradores na identificação de tentativas de phishing com o objetivo de prevenir estes ataques. Com a IA, os cibercriminosos dispõem de uma ferramenta que se pode utilizar para analisar grandes volumes de dados dos seus alvos e criar mensagens que garantirão uma maior taxa de êxito. As investigações de segurança da ZeroFox demostraram esta abordagem para apanhar utilizadores do Twitter com SNAP_R (Social Network Automated Phishing with Reconnaissance) [VER AQUI]. A SNAP_R utiliza IA para identificar alvos valiosos e desenvolver rapidamente um perfil desse alvo, com base no que publicaram no passado naquela rede social. Recorrendo a este método, convenceram os alvos a clicar em links maliciosos 30% das vezes (comparado com a taxa de êxito entre 5 a 15% de outros esquemas automatizados).

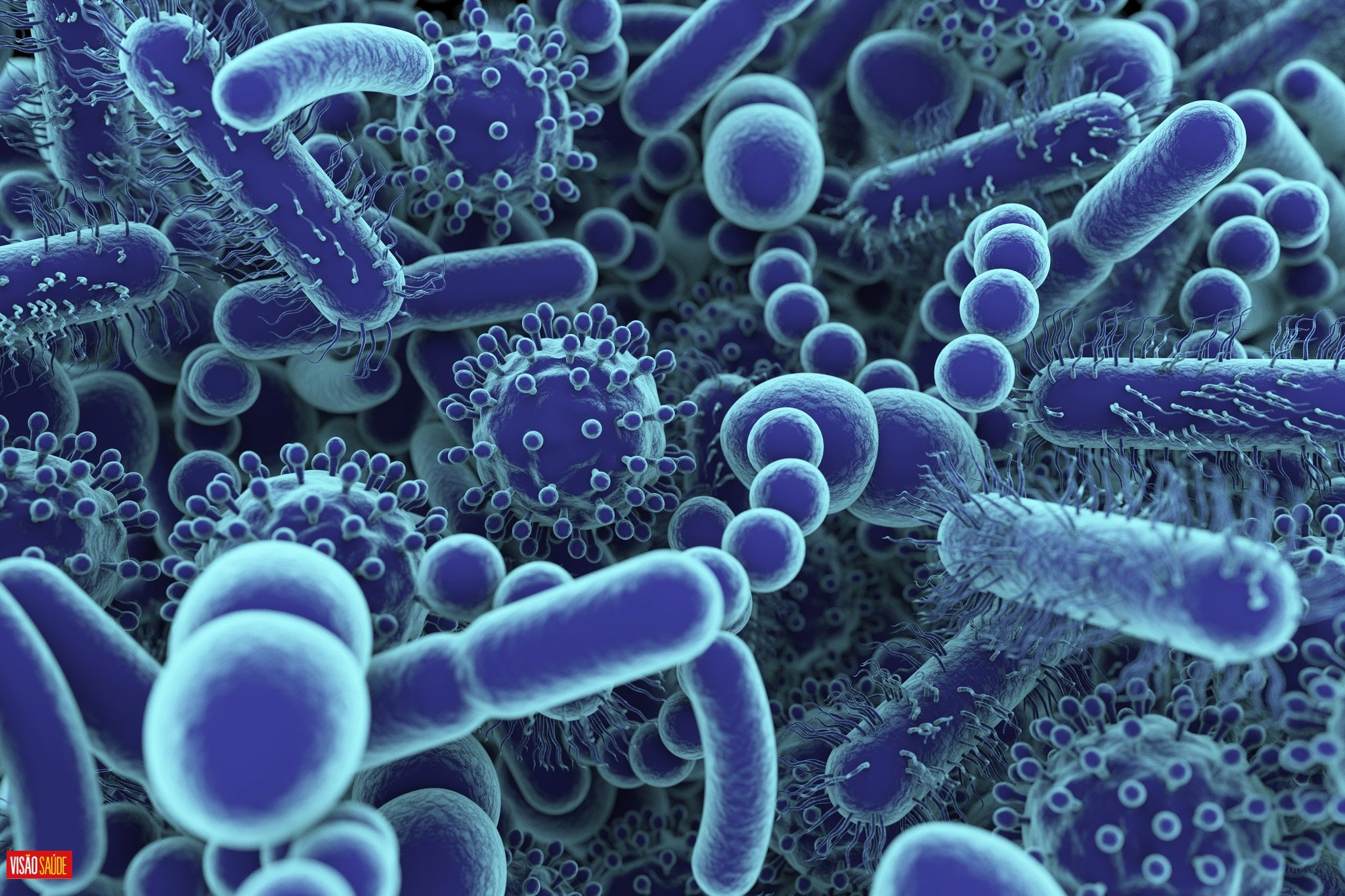

▪ Desenvolver malware altamente evasivo. Os hackers confiaram durante muito tempo em scripts e kits de ferramentas para desenvolver e distribuir malware, mas à medida que a ciberdefesa se tornou mais inteligente e sofisticada, os nossos adversários passaram a recorrer a técnicas de inteligência artificial de baixo perfil para aumentar a evasão do malware. Os criadores de malware começaram a utilizar a IA para realizar verificações, com o objetivo de identificar as configurações de hardware e o ambiente [VER AQUI] em que se encontram (por exemplo, um ambiente Sandbox versus uma máquina física), assim como para determinar se um humano está a operar a máquina nesse momento. DeepLocker, desenvolvido por investigadores da IBM Research [VER AQUI], demonstra os perigos da inteligência artificial utilizada como uma arma no malware. A IA do DeepLocker está treinada para assegurar que a sua carga útil só seja executada quando atinja um alvo específico, baseando-se em três camadas de ocultação, para evitar que as ferramentas de segurança identifiquem uma ameaça.

Em conclusão e definitivamente, à medida que a corrida às armas da cibersegurança aquece motores, é inquestionável que estamos a aproximar-nos de uma nova etapa em que a IA e a machine learning representarão um papel cada vez mais importante tanto no ataque como na defensa.