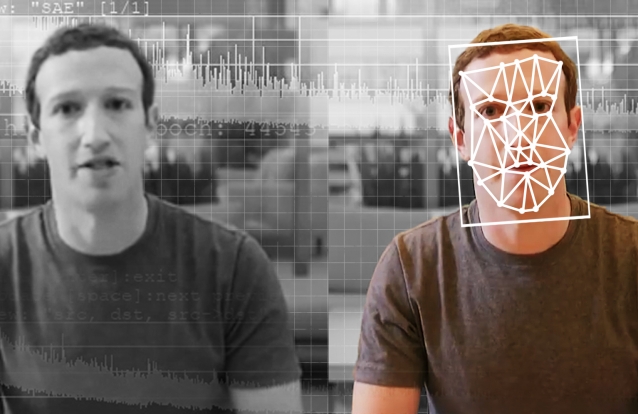

A Onfido, uma empresa especializada em tecnologia de verificação de identidades, concluiu que as fraudes com recurso a deepfakes (vídeos manipulados por Inteligência Artificial para fins maliciosos) aumentaram 3000% em 2023 face ao ano anterior. A proliferação de apps que permitem colocar a cara de qualquer pessoa sobre outro conteúdo e reproduzir uma ilusão é um dos contribuidores para este aumento. Estas aplicações usam IA generativa para fundir e misturar os elementos de uma imagem sobre outra.

Em versões mais sofisticadas, estas apps podem vir a ser usadas para enganar sistemas de reconhecimento facial, autorizar transações fraudulentas ou mesmo aceder a informação empresarial sensível, alerta a Onfido.

O The Next Web explica que a Onfido calculou que os ataques que usam manipulações de menor qualidade, os chamados ‘cheapfakes’, totalizam 90,3% de todos os ataques registados pela empresa em 2023, sinal de que os criminosos estão a tentar privilegiar a quantidade sobre a qualidade, conduzindo os ataques para obter a maior recompensa possível com o menor esforço envolvido.

Apesar do aumento destas fraudes, a Onfido continua a defender que a verificação por biometria é uma poderosa defesa e estima que estes sistemas tenham recebido três vezes menos tentativas fraudulentas de acesso do que os outros sistemas. Vincent Guillevic, responsável pelo departamento da Onfido que produziu o estudo, lembra que “os criminosos são pioneiros, estão sempre à procura de oportunidades e a evoluir continuamente as suas táticas”.

A recomendação da Onfido é que se ative, sempre que possível, o reconhecimento biométrico ‘live’, ou seja, que exija que o utilizador esteja presente no momento da verificação, de forma a não serem enganados por deepfakes, fotos, gravações ou mesmo um indivíduo mascarado. Com o aumento de sofisticação da IA generativa ao alcance de qualquer um, preveem-se ataques mais complexos e a defesa terá de passar por usar outros indicadores, como sinais não visuais, como inteligência no dispositivo, geolocalização e análise de potenciais sinais de fraude em segundo plano nas imagens e vídeos.