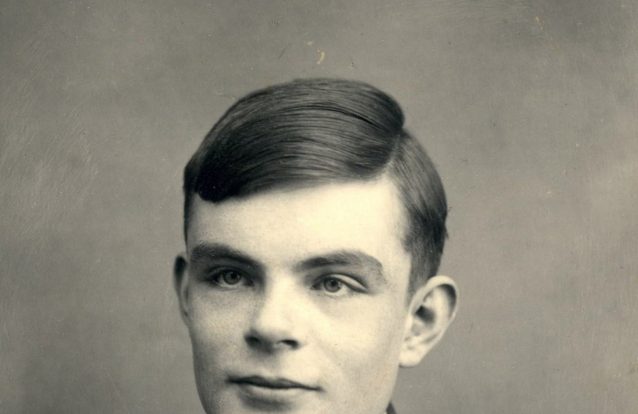

Os criadores russos da FaceApp explicam que a aplicação usa uma forma de Inteligência Artificial para analisar as imagens de rostos e torná-los realisticamente mais velhos, mais novos, mais atraentes ou mudar-lhes o género, por exemplo. Apesar de ter surgido em 2017, só agora é que a popularidade da aplicação cresceu exponencialmente, tornando-a líder em vários países. Apesar do reconhecimento e de todo o buzz criado, há vários especialistas a alertar para o perigo que a app coloca em termos de privacidade.

Stilgherrian, comentador de tecnologia, explica que a política de privacidade é bastante generalista, não oferecendo qualquer espécie de proteção aos direitos dos utilizadores. Outra polémica envolvendo a FaceApp passa pelo filtro de embelezamento, que, quando ativado, estaria a tornar os tons de pele mais brancos. Este desempenho valeu as acusações de racismo aos criadores da app, com Yaroslav Goncharov, o fundador, a pedir desculpa e a prometer corrigir a situação em breve. «É um efeito secundário infeliz da rede neural subjacente causado pelo conjunto de dados de treino e não um comportamento desejado», cita o ABC News da Austrália.

Há pareceres de que a FaceApp é perfeitamente segura: «quem quer que tenha colocado a sua cara online, em conjunto com o nome e outros dados identificáveis (por exemplo, qualquer pessoa com um perfil de rede social), já está bastante vulnerável a ser digitalmente capturado para reconhecimentos faciais futuros», considera o advogado Michael Bradley, reforçando que «esta app em particular não traz mais risco adicional», apesar de a política de privacidade referir que «se o negócio for vendido, os dados dos utilizadores e o consentimento também serão incluídos».

O presidente da Privacy Foundation da Austrália, David Vaille, defende que os criadores da FaceApp «pedem muitos mais direitos do que aqueles de que precisam para fornecer o serviço (…) podem remover os dados de qualquer regime de proteção legal eficaz, partilhá-los com quase toda a gente e retê-los indefinidamente».

Os especialistas alertam que os dados e as imagens podem ser usados para novos treinos de algoritmos de reconhecimento facial ou para outras circunstâncias.